PoC에서는 답이 잘 나왔는데 운영에 올리니 답이 요동친다는 말을 반복해서 들었다. 문서가 늘고, 임베딩과 프롬프트가 바뀌고, 모델 버전이 오가면 RAG 품질은 반드시 흔들린다. 평가 파이프라인이 없으면 어디서 무너졌는지조차 추적이 안 된다.

품질은 단계별로 측정하고 묶어야 유지된다

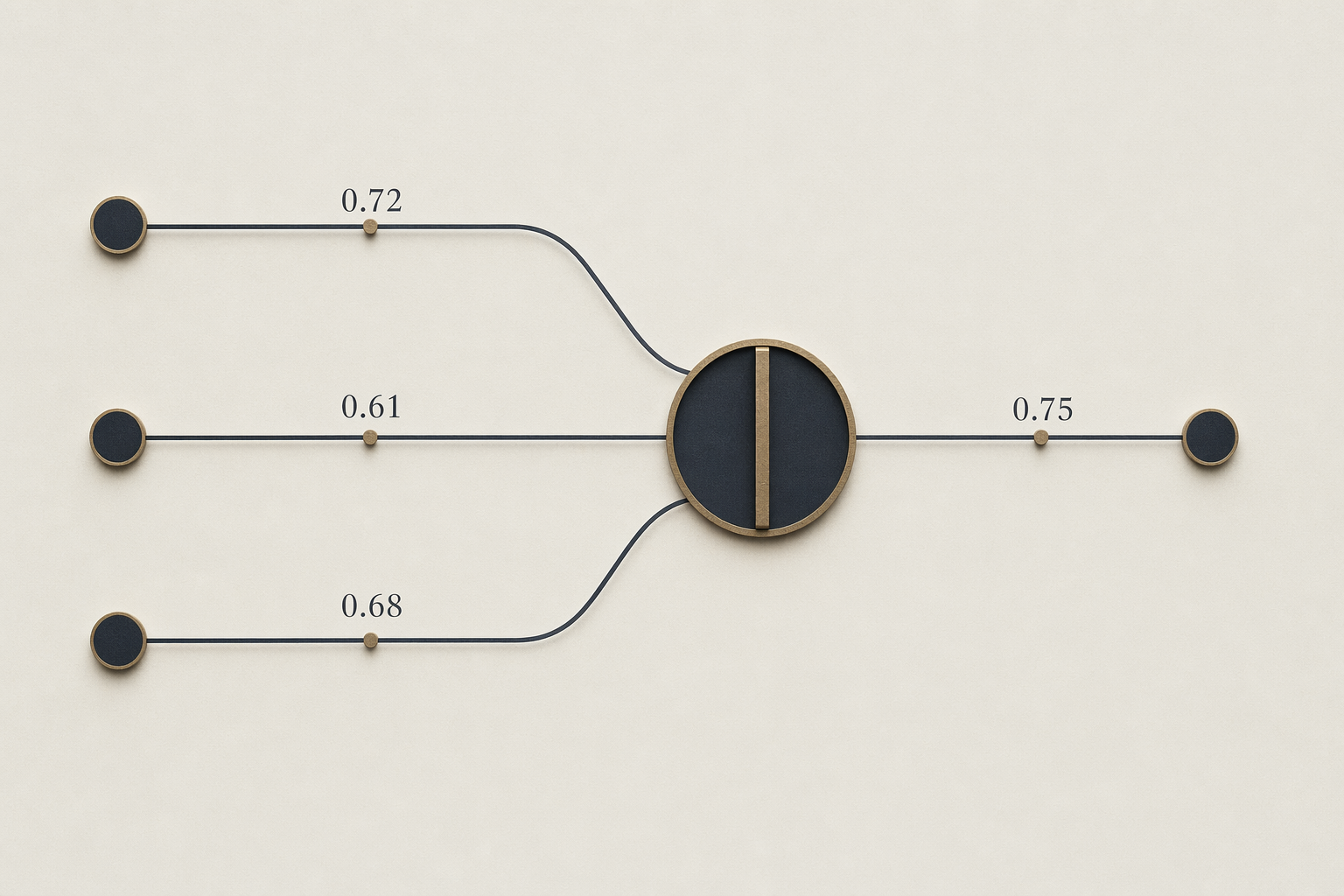

RAG 평가는 두 축이 기본이다. 검색된 문서의 관련도(context relevance)와, 생성된 답의 근거 일치(groundedness/faithfulness)다. 여기에 응답 적절성(answer relevance)과 지연/비용(latency/cost)을 더해 운영 지표를 완성한다.

- Context Relevance: 질의와 검색 문서의 관련도.

- Groundedness/Faithfulness: 검색 근거 밖 내용을 만들지 않는 정밀도. 할루시네이션 억제의 핵심.

- Answer Relevance: 사용자 질의에 대한 응답 적절성.

- Latency/Cost: 품질과 효율을 함께 보는 운영 지표.

검색 단계에는 precision/recall을 같이 둔다. 검색된 문서 중 실제 관련 비율(precision)과, 전체 관련 문서 중 검색된 비율(recall) 모두를 본다. 정확도와 커버리지는 항상 교환관계다. 한쪽만 올리면 현장 불만이 바로 터진다.

평가는 기능이 아니라 운영이다. 3단계 지표와 게이트 없이는 RAG는 매주 퇴화한다.

색인–검색–생성: 노드 단위 지표로 분해하라

평가 파이프라인은 색인→검색→생성의 3단계 노드를 기준으로 쪼갠다. 각 노드에 맞는 지표와 테스트 러닝을 붙이면 결함 위치가 드러난다.

- 색인(Indexing): 청크 크기, 임베딩 모델, 메타데이터 품질을 고정항으로 관리한다. 청크가 과도하면 관련도는 오르고 groundedness가 무너진다. 메타데이터 누락은 recall을 잠식한다. 색인 변경 시 테스트 세트로 context relevance와 검색 recall을 재측정한다.

- 검색(Retrieval): top-k 정확도를 기준으로 본다. 쿼리 리라이팅의 전후 효과를 측정해 고정한다. precision/recall 기준선을 유지하지 못하면 k, rewriter, 랭커를 차례로 조정한다.

- 생성(Generation): groundedness와 answer relevance가 핵심이다. 답변이 근거 문서에 정확히 의존하는지(groundedness), 질문 의도에 맞게 응답하는지(answer relevance)를 분리 채점한다. 포맷 일치(예: JSON, 템플릿)는 별도 체크로 둔다.

운영 표준: 오프라인 러닝→노드 평가→로그 자동평가→CI 게이트

2025년 RAG 운영 팀 표준은 네 가지를 묶는다. 이 네 가지를 동시에 돌려야 품질 회귀를 막는다.

- Offline 테스트 러닝: 대표 질의·정답·근거 세트를 만들어 주기적으로 재실행.

- Node-level eval: 색인/검색/생성 각 노드에 전용 지표 부착.

- Automated log evaluation: 실사용 로그를 자동 샘플링해 위 4대 지표로 평가.

- CI/CD gate: 기준 미달 시 배포 중단. 품질 회귀 방지의 마지막 안전장치.

다음 표처럼, 평가 파이프라인 유무는 운영 난이도를 갈라놓는다.

| 항목 | 평가 없는 RAG | 3단계 평가 파이프라인 |

|---|---|---|

| 장애 원인 파악 | 생성 탓으로 몰림 | 색인/검색/생성 중 결함 노드 특정 |

| 변경 대응(문서/모델) | 영향 범위 불명 | 노드별 기준선 재측정으로 영향 분리 |

| 품질 관리 | 체감 기반 분쟁 | Context/Answer/groundedness 수치로 합의 |

| 비용·지연 | 임시 최적화 반복 | Latency/Cost를 게이트로 고정 |

| 확장성 | 팀 개인기 의존 | 테스트 러닝+자동평가로 팀 지식화 |

이번 분기에 바로 넣을 실행 체크리스트

- 대표 질의·정답·근거로 최소 테스트 러닝을 만든다(검색 관련도·groundedness·answer relevance 포함).

- 색인 파라미터(청크, 임베딩, 메타데이터) 변경 시 재색인 전후의 recall/precision을 비교한다.

- 검색 노드에 top-k 정확도와 쿼리 리라이팅 A/B를 상시 측정한다.

- 생성 노드에 groundedness와 answer relevance 자동 채점을 붙이고 포맷 일치 검사를 추가한다.

- CI/CD에 4대 지표와 Latency/Cost 기준을 게이트로 걸고, 미달 시 롤백을 자동화한다.

요지는 단순하다. 색인·검색·생성을 분리 측정하고, 4대 지표를 CI 게이트로 묶어 품질 변동을 고정하라. 이것이 현장 표준이다. 더 구체적인 절차와 산출물 템플릿은 AX Ops 방법론에 정리해 두었다: AX Ops 방법론 →

참고

- Future AGI — RAG Evaluation Metrics Guide 2025 — https://futureagi.com/blogs/rag-evaluation-metrics-2025

- Microsoft Foundry — RAG Evaluators for Generative AI — https://learn.microsoft.com/en-us/azure/foundry/concepts/evaluation-evaluators/rag-evaluators

- Maxim AI — RAG Evaluation: A Complete Guide for 2025 — https://www.getmaxim.ai/articles/rag-evaluation-a-complete-guide-for-2025/

- Toloka — RAG Evaluation: A Technical Guide — https://toloka.ai/blog/rag-evaluation-a-technical-guide-to-measuring-retrieval-augmented-generation/